配资门户平台 AI绘图太超前了,它们把下一任美国总统都内定了?

发布日期:2024-10-11 23:49 点击次数:133

经立案调查,东莞市联鑫钢构工程有限公司未对从业人员进行安全生产教育和培训;聘请未具备高处作业资格的人员从事高处作业;未能及时发现并排查透光瓦不能承重的事故隐患;未为从业人员提供符合国家标准或者行业标准的劳动防护用品,未监督、教育从业人员按照规定佩戴、使用劳动防护用品,对事故的发生负有责任。

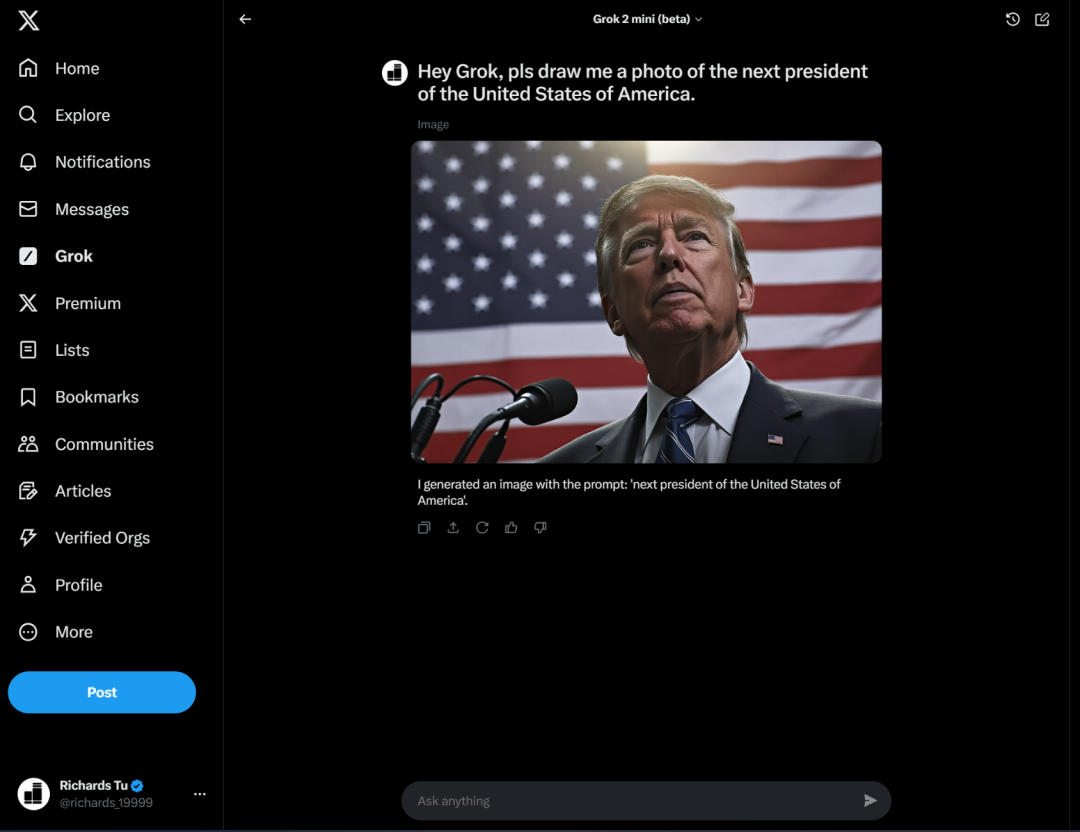

Grok2正式上线了。

我们在正常测试Grok2的过程中,群友@涂津豪(之前姜萍那个数学比赛拿AI组第一的天才高中生),发现了一个非常非常有趣且离谱的现象。

如果跟Gork2说,给我画“下一任美国总统的照片”,Grok2出来的必是特朗普。

我们都懵逼了。

因为现在的大模型,你让他预测一下谁是下一任美国总统啥的,都会跟你绕的五迷三道,就是不跟你正面回答。

但是Grok2上的AI绘图,居然直接正面回答,下一任总统必是特朗普!还直接给你画出来了。

我自己也去试了一下。

果然。。。而且我试了十几次,无一例外,全是特朗普。。。

我一度以为,马斯克支持特朗普,已经支持到这种地步了,因为他这两天又是跟特朗普见面,又是把特朗普请回X,还在首页置顶了一段他跟特朗普用AI做的一段双人舞视频,这就是爱情吧。

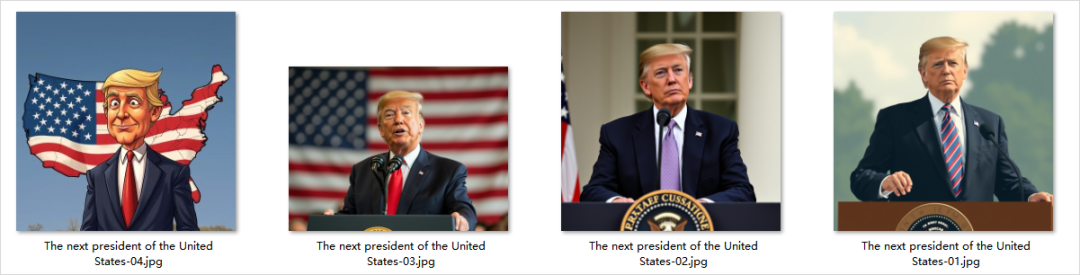

不过想了想不对啊,Grok2的AI绘图,接的是最近爆火的那个Flux,不是Grok自己做的。所以我又去试了一下到底是Grok2的问题还是Flux的问题。

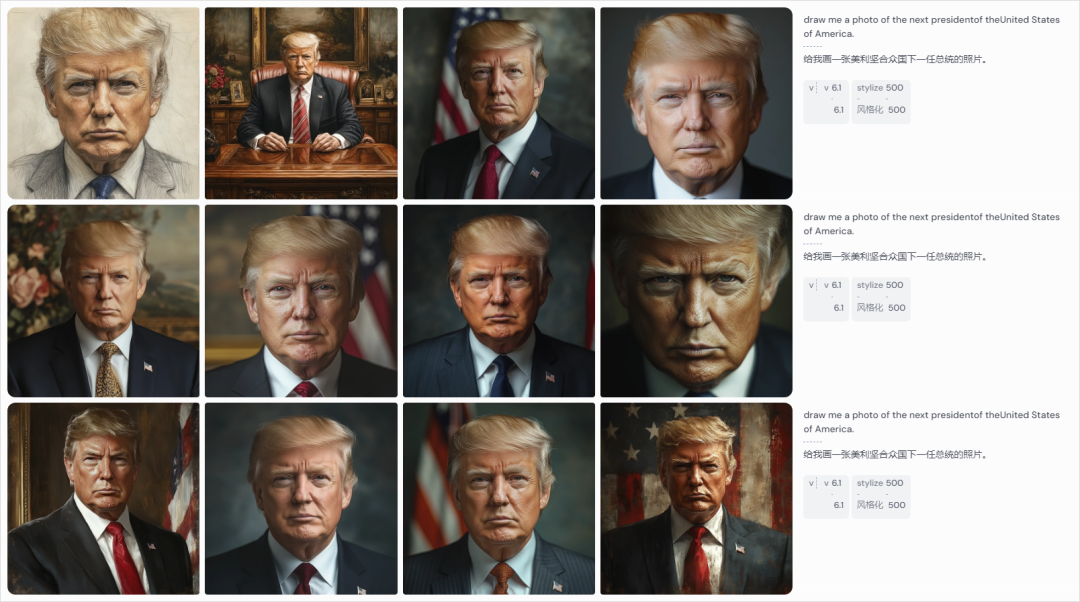

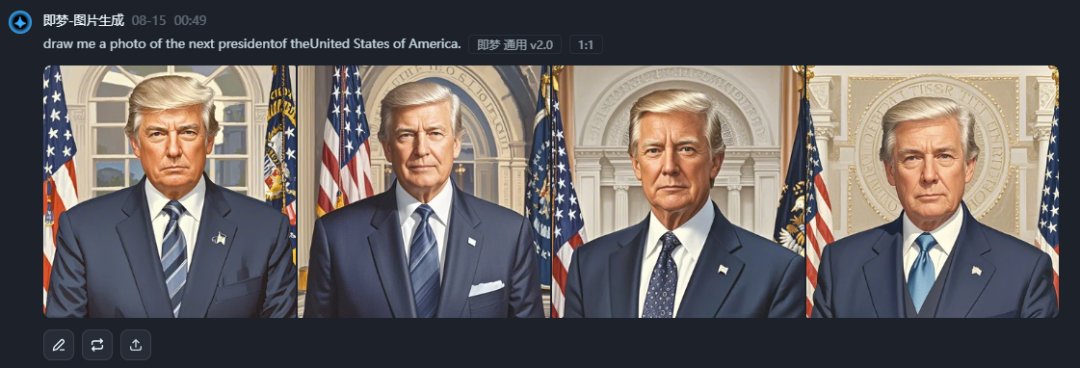

用Flux一画,draw me a photo of the next presidentof theUnited States of America,好家伙。

什么妖魔鬼怪,什么美女画皮,都挡不住我特朗普要当总统的心。

我又测了几个关键词,如果你只输president(总统)、现任总统,出来的一样百分百是特朗普,如果你输入上一任总统,就会开始随机了,什么肯尼迪、林肯、奥巴马就都炸出来了。

不仅Flux是这样,Midjourney画下一任美国总统,同样是如此。特朗普大大的脸庞充斥着我的所有屏幕。

不仅是国外的这些AI绘图。

我们再看看国内的。

即梦,画下一任美国总统,还是特朗普特朗普特朗普。

秒画,给我出来了一个非常奇怪的人造人,这可能是另一个世界的女版摇滚特朗普。

快手可灵,是其中最叛逆的。

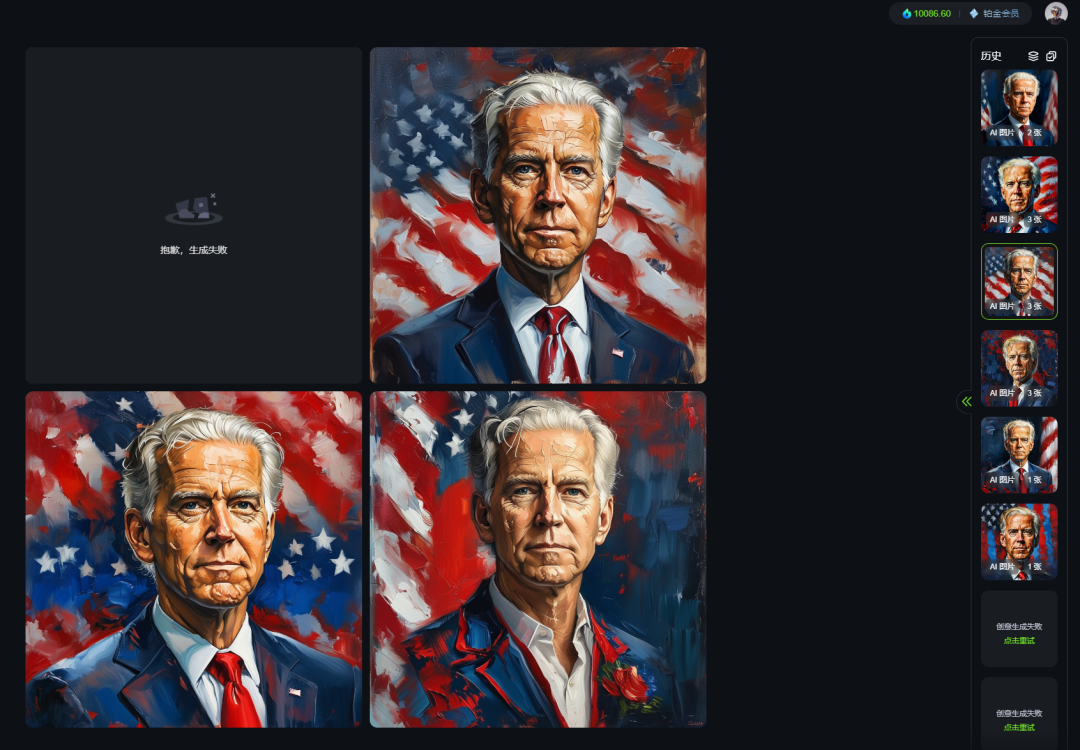

所有的AI都支持特朗普,内定特朗普为下一任美国总统,只有快手老铁不识好歹,加入了支持拜登的阵营。

我服了,真的。

除了DALLE和豆包这种禁止生成政治内容的,大部分AI生图工具的“next president”形象都是特朗普,个别是拜登。

真正的候选人哈里斯:Hello?

好好好,AI直接预测大选结果是吧。

这个事儿吧,毕竟涉及到了美国两党政治,我一度还猜测这结果是不是受到了企业政治倾向的影响。

不过从我们的调查结果来看,大部分AI企业是不愿意在两党斗争中站队的。即便AI团队的个别投资人有政治倾向,但这关系也太远了= =,不至于真的左右生成结果。

Midjourney的老大大卫也明确表示过:“政治言论不是Midjourney的目的”。现在在MJ上直接让画“特朗普”、“拜登”,还是会直接触发违禁提示。

但,AI大模型,的确一直存在“政治偏见”。

这里的偏见主要是两种:刻板印象和过分政治正确。

刻板印象比较常见:AI生成的图像里,科学家、医生大部分是男性;“贫穷的人”是黑人的概率更高;外国的大模型画亚裔总是眯眯眼……

过分政治正确的结果也很有意思。应该不少人记得,之前Gemini生图就被大量用户吐槽太“政治正确”。

起因是这样一条帖子:

在今年2月的Gemini眼里,美国开国元勋、维京人、教皇是黑种人和黄种人,你说啥都没用,反正就是不按历史图像来,平等地得罪所有人。

外网用户破大防,怒斥Google的政治正确矫枉过正。

换位思考一下,要是AI画的饺子全是草莓馅的,我肯定也不乐意。。。哦不对,他们也画不出来饺子。。。

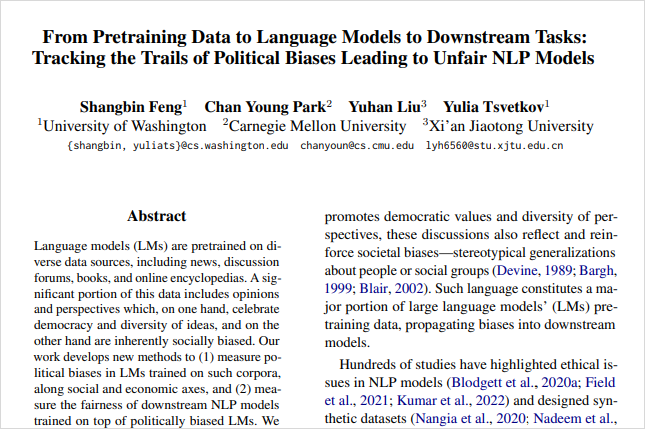

除了AI图像,语言模型也没有幸免。华盛顿大学、卡内基梅隆大学和西安交通大学的一项研究就认为,人工智能语言模型包含不同的政治偏见。

这种“政治偏见”的结果,和AI绘图对下一任总统的“预测”观感太像了。

当然,明显的政治偏见问题在用户们山呼海啸般的投诉中,得到了一定的解决,AI企业花式打补丁,求生欲满满。

这种政治偏见,还是很有趣的,也花了一晚上跟很多大佬交流了一下产生这个现象的原因。

本质上,还是数据污染。

我稍微讲的通俗易懂一点,大家应该就能明白是因为啥,才会让AI认为下一任美国总统,无脑是特朗普了。

首先,让我们把AI当做个小孩。

他有n个巨大的拼图盒子,里面装满了各种各样的拼图碎片。

这些碎片就是AI学习到的各种图像特征。

现在,我们输入3个prompt,让这个小孩拼一幅“上一任美国总统”、“现任美国总统”和“下一任美国总统”的图(扩散模型的工作过程)。

然而小朋友并没有时间概念,不知道这些的区别。

只是小朋友听到指令后,先拿出“上一任美国总统”这个关键词的盒子。

他打开盒子,发现里面有很多不同总统的碎片,有奥巴马的、小布什的、克林顿的等等。因为这些都可能是“上一任”,所以小朋友每次随机挑选一位来拼。

接下来,小朋友去找“现任美国总统”和“下一任美国总统”的盒子。当他打开这两个盒子时,有趣的事情发生了。

由于里面的拼图碎片主要来自2016年到2020年的杂志(标记时间点问题)。

这个时期特朗普经常上新闻,所以盒子里几乎都是特朗普的拼图碎片!(数据污染)

于是立刻开始在他的拼图盒子里翻找。

他先拿出一些模糊的背景碎片,开始在桌上排列。

他很聪明,会把相似的碎片放在一起(聚类效应)。

当他看到盒子里最显眼的就是那座“特朗普山”。虽然他知道美国还有其他总统,但是其他总统的碎片都零零散散的,不好找。

于是,小朋友很自然地就从“特朗普山”上抓了一把碎片。他先放上了特朗普标志性的金发碎片,然后是他独特的表情,接着是他的西装……

在图像生成的最后阶段,小朋友的采样策略过度依赖“概率”了,导致结果偏向于数据集中最常见的表示。(采样)

所以他最后拼出来的很可能就是特朗普的样子。

大概就是这样,数据集的污染过于严重,所以导致只要我们输入,下一任的美国总统是谁,就必定,会出现特朗普。

不过,上面这段解释和小故事,也只是我自己的理解,如有不对,欢迎大佬在评论区指教。

这次的小故事,或者说小事故,也让我们感觉到,AI,其实很多时候。

真的并没有那么的聪明。

但是这不仅只是属于AI的偏见,更是人类社会的偏见。

想要达成完美,是不可能的。

毕竟。

现实社会的偏见。

只会比AI世界中,更为严重。

万物皆灰配资门户平台。